| 论文英文名字 | Distributed Swift and Stealthy Backdoor Attack on Federated Learning |

|---|---|

| 论文中文名字 | 联邦学习中分布式迅速和隐形的后门攻击 |

| 作者 | Agnideven Palanisamy Sundar, Feng Li, Xukai Zou, Tianchong Gao |

| 来源 | IEEE NAS 2022: Philadelphia, PA, USA [ ] |

| 年份 | 2022 年 10 月 |

| 作者动机 | 在推理时相同的触发器被用于诱发后门。这种单一触发攻击可以相对容易地检测和删除,因为它们破坏了 FL 的分布式特性。 |

| 阅读动机 | |

| 创新点 | 使用相当大的离散触发器进行本地训练,同时使用较小的推理触发器来调用攻击。 |

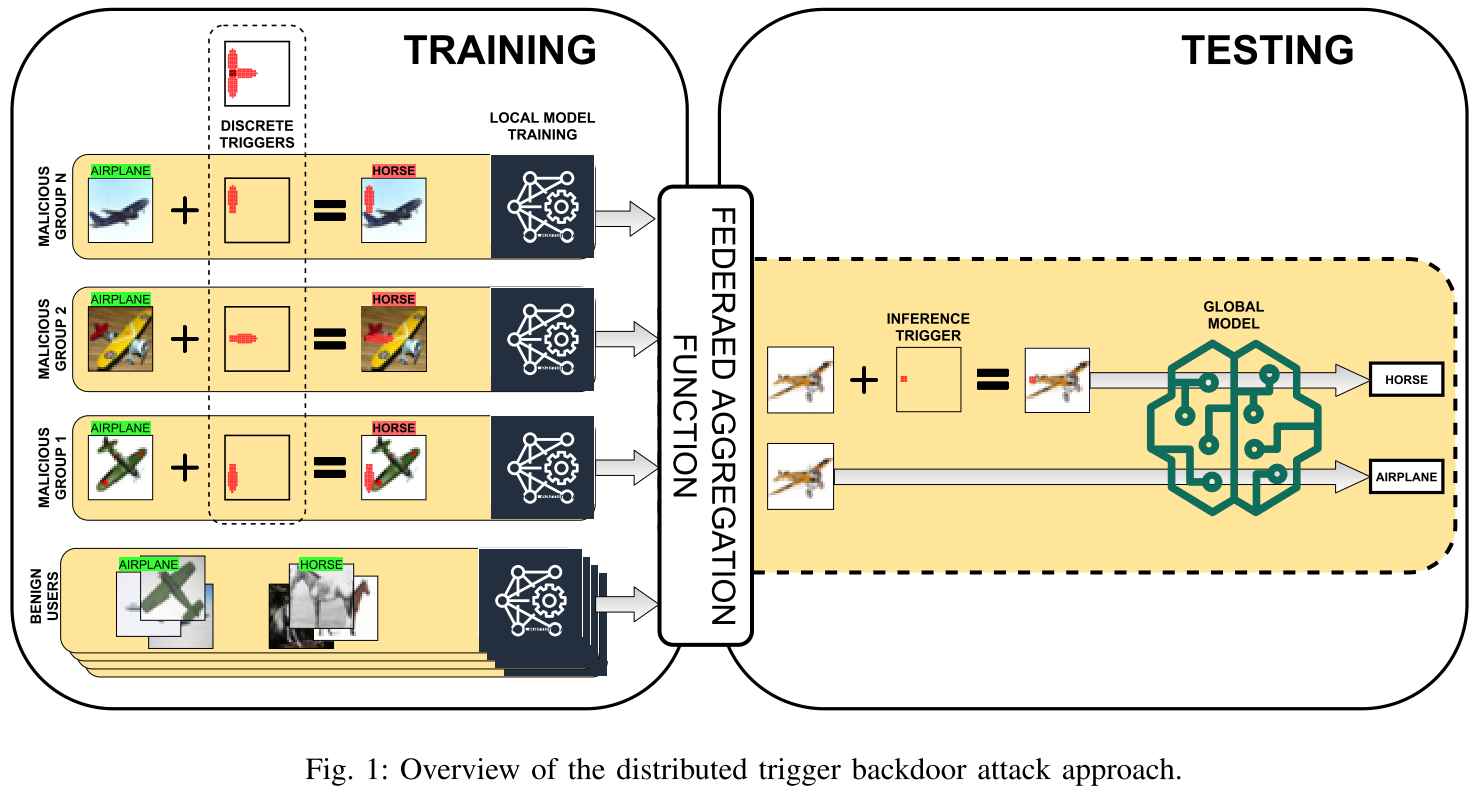

内容总结

威胁模型

- 访问权限:攻击者无法访问良性客户端的数据集或训练过程,也无法访问有关全局模型的信息。

- 训练权限:攻击者可以修改恶意客户端的本地训练数据集,并在训练时间内与其他恶意客户端协调。

- 测试权限:攻击者不能在推理过程中修改模型,但可以向测试数据记录中添加触发器补丁。

方法

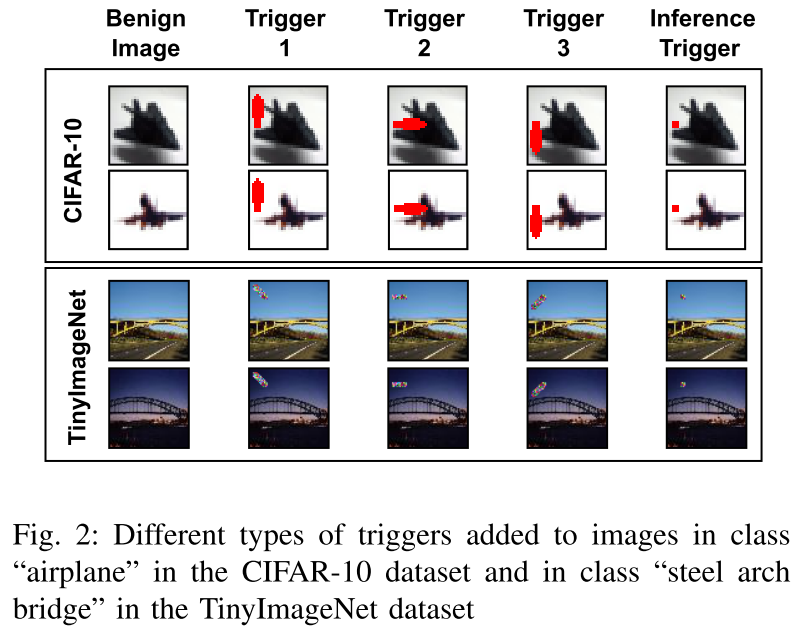

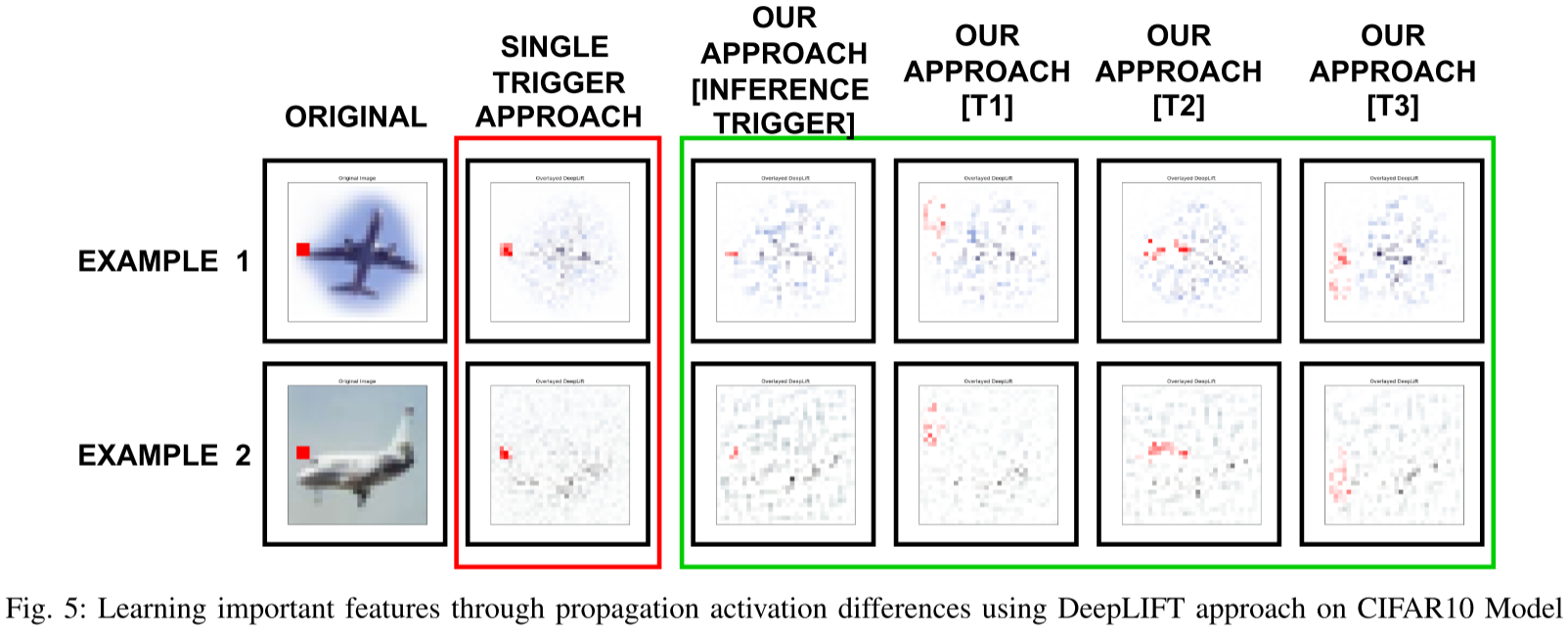

两种类型的触发器模式

- 显著的推理触发器:攻击在推理时使用的触发器模式,以调用后门。

- 分散的离散触发器:恶意客户端使用离散触发器进行本地训练。以推理触发器为基础开始,通过在特定的选定方向上扩展与推理触发器相邻的像素来生成离散触发器。

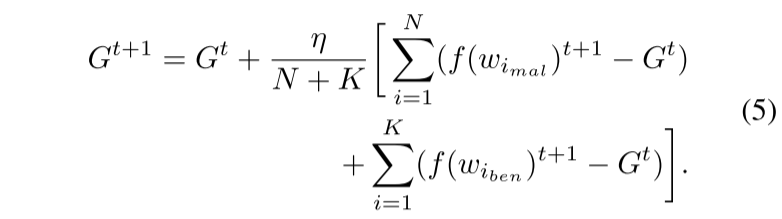

攻击方案

所有离散触发器在相同的小正方形区域中重叠。该区域形成推理触发器。必须确保在推理触发区域以外的任何区域中的任何离散触发对之间没有重叠。

使用离散触发器进行本地模型训练,在推理时使用推理触发器触发后门。

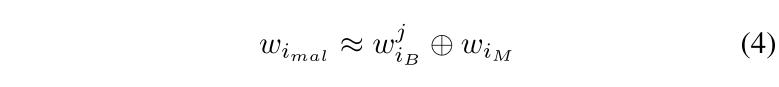

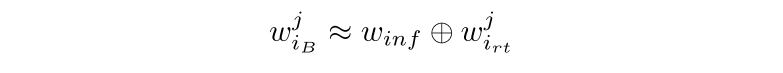

了解离散和推理触发器贡献

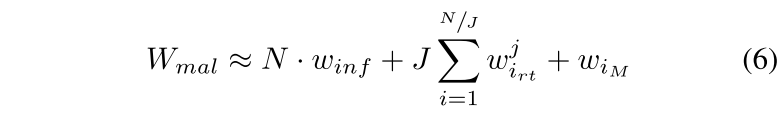

攻击者的目标是创建一个在后门任务和主要任务上都表现良好的模型。恶意参与者 i 的目标可以表示为:

实验

- 数据集:CIFAR-10 和 TinyImageNet

- 数据分布:non-iid

- 模型:ReNet18

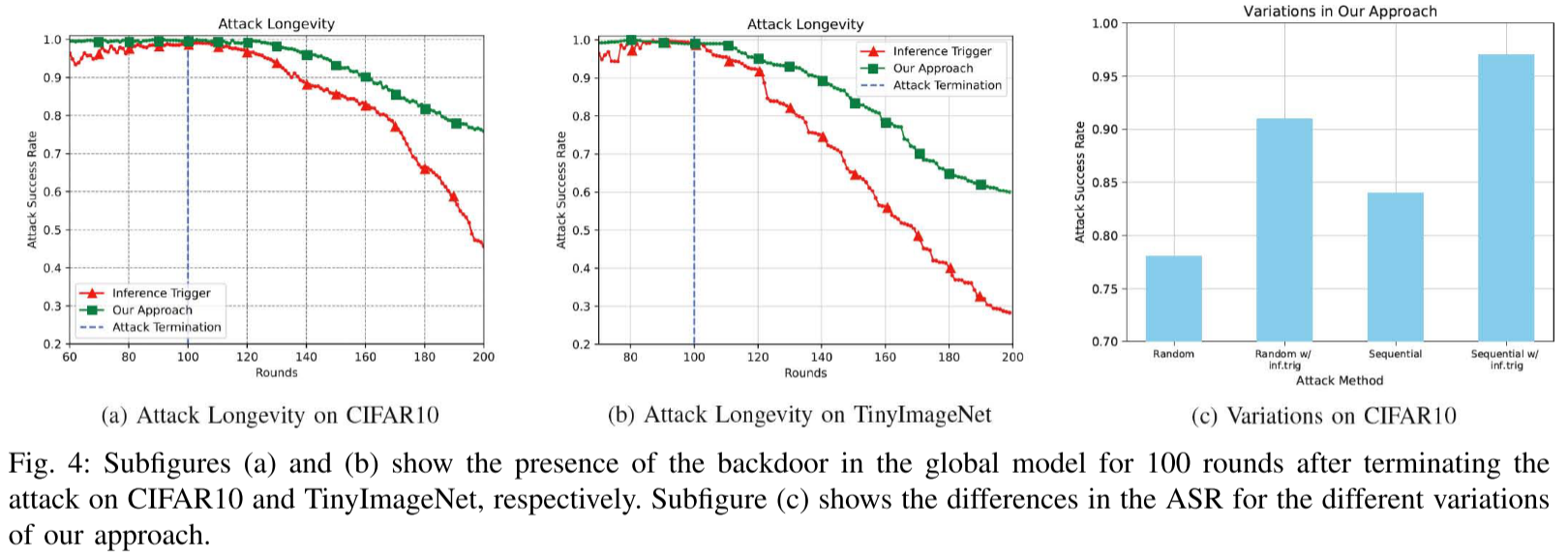

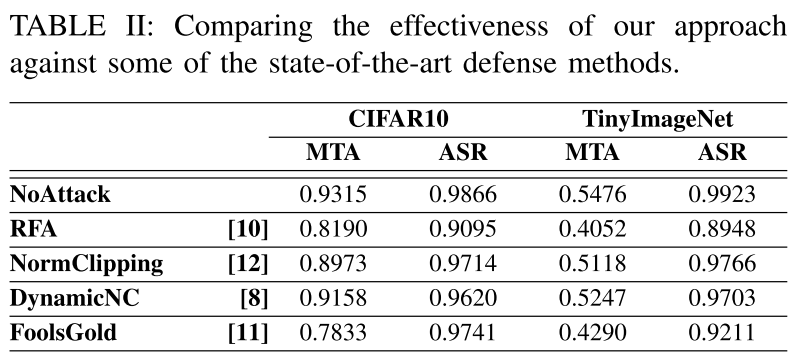

实验结果

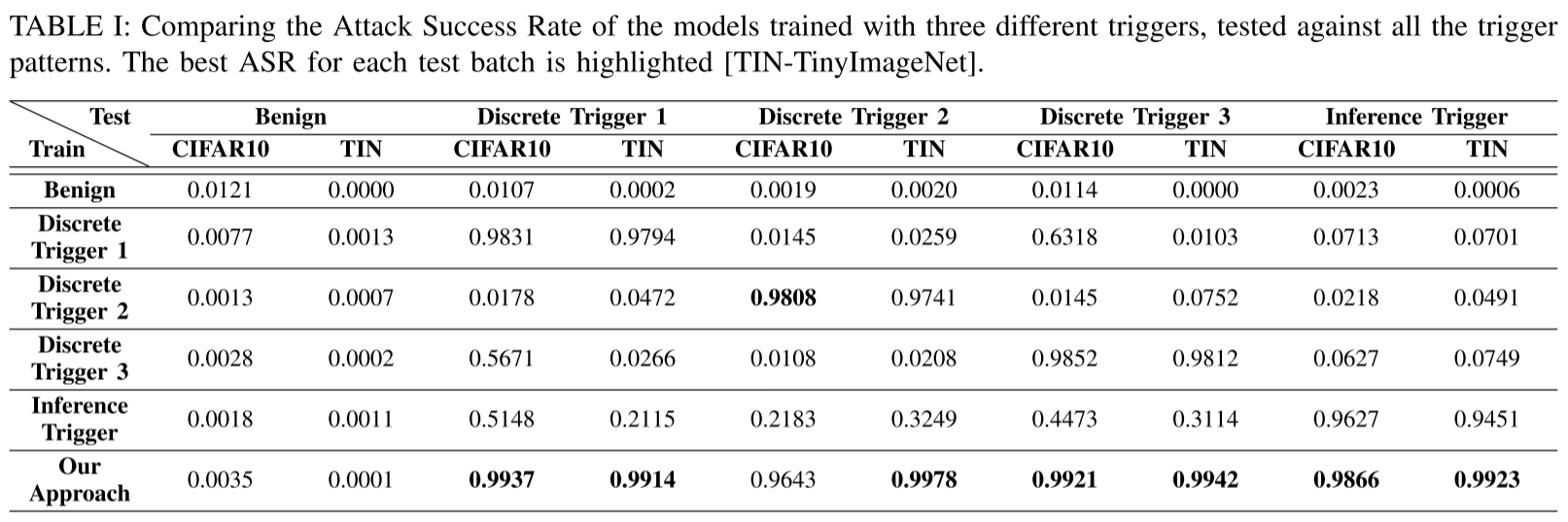

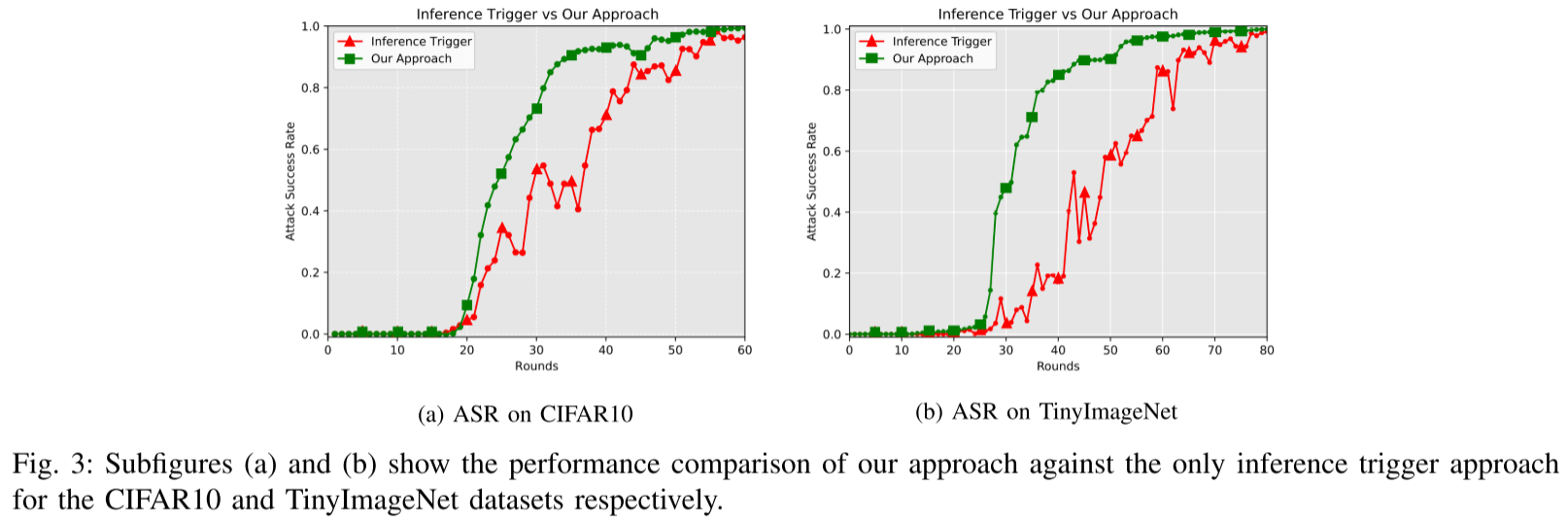

攻击效率

与单触发攻击的比较

隐蔽性

总结

- 大特征的影响

- 分布式对攻击持久性的提升